1. Introduction

Présentation

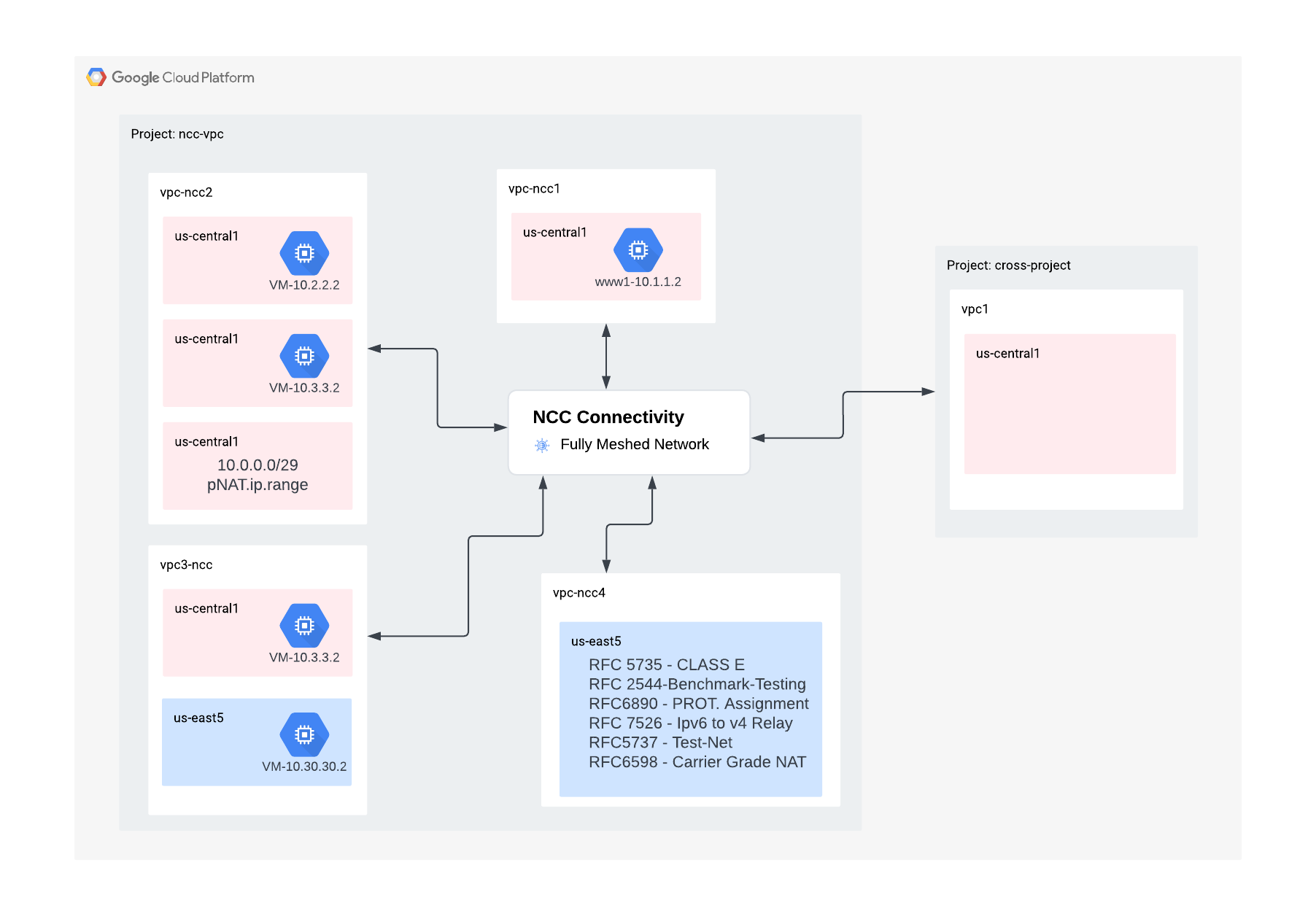

Dans cet atelier, les utilisateurs vont découvrir comment Network Connectivity Center(NCC) peut être utilisé pour établir une connectivité inter-VPC à grande échelle en prenant en charge les spokes VPC. Lorsque les utilisateurs définissent un VPC en tant que spoke VPC, cela leur permet de le connecter à plusieurs réseaux VPC via le hub NCC. L'utilisation de NCC avec configuration de spokes VPC réduit la complexité opérationnelle liée à la gestion de la connectivité inter-VPC par paire via l'appairage de VPC, au lieu d'utiliser un modèle de gestion centralisée de la connectivité.

N'oubliez pas que Network Connectivity Center (NCC) est un modèle de plan de contrôle en étoile pour la gestion de la connectivité réseau dans Google Cloud. La ressource hub fournit un modèle de gestion centralisée de la connectivité pour interconnecter les spokes.

Objectifs de l'atelier

Dans cet atelier de programmation, vous allez créer une topologie en étoile logique avec le hub NCC, qui implémentera une structure de connectivité VPC entièrement maillée sur trois VPC distincts.

Points abordés

- Connectivité VPC maillée complète avec NCC

- NAT privé sur VPC

Prérequis

- Connaissances du réseau VPC GCP

- Connaissances de Cloud Router et du routage BGP

- Deux projets GCP distincts

- Cet atelier de programmation nécessite cinq VPC. L'un de ces VPC doit se trouver dans un projet distinct de celui du hub NCC

- Vérifiez vos Quota:Networks et demandezdes réseaux supplémentaires si nécessaire. Capture d'écran ci-dessous:

Objectifs

- Configurer l'environnement GCP

- Configurer Network Connectivity Center avec VPC en tant que spoke

- Valider le chemin de données

- Découvrir les fonctionnalités de service NCC

- Nettoyer les ressources utilisées

Avant de commencer

Console Google Cloud et Cloud Shell

Pour interagir avec GCP, nous allons utiliser à la fois la console Google Cloud et Cloud Shell tout au long de cet atelier.

Projet du hub NCC Console Google Cloud

La console Cloud est accessible à l'adresse https://console.cloud.google.com.

Configurez les éléments suivants dans Google Cloud pour faciliter la configuration de Network Connectivity Center:

Dans Google Cloud Console, sur la page de sélection du projet, sélectionnez ou créez un projet Google Cloud.

Lancez le Cloud Shell. Cet atelier de programmation utilise $variables pour faciliter l'implémentation de la configuration gcloud dans Cloud Shell.

gcloud auth list

gcloud config list project

gcloud config set project [HUB-PROJECT-NAME]

projectname=[HUB-PROJECT-NAME]

echo $projectname

gcloud config set compute/zone us-central1-a

gcloud config set compute/region us-central1

Rôles IAM

NCC nécessite des rôles IAM pour accéder à des API spécifiques. Veillez à configurer votre utilisateur avec les rôles IAM NCC si nécessaire.

Rôle/Description | Autorisations |

networkconnectivity.networkAdmin permet aux administrateurs réseau de gérer le hub et les spokes. | networkconnectivity.hubs.networkconnectivity.spokes. |

networkconnectivity.networkSpokeManager : permet d'ajouter et de gérer des spokes dans un hub. À utiliser dans un VPC partagé où le projet hôte possède le hub, mais les autres administrateurs d'autres projets peuvent ajouter des spokes pour leurs rattachements au hub. | networkconnectivity.spokes.** |

networkconnectivity.networkUsernetworkconnectivity.networkViewer permet aux utilisateurs du réseau d'afficher différents attributs de hub et de spoke. | networkconnectivity.hubs.getnetworkconnectivity.hubs.listnetworkconnectivity.spokes.getnetworkconnectivity.spokes.listnetworkconnectivity.spokes.aggregatedList |

2. Configurer l'environnement réseau

Présentation

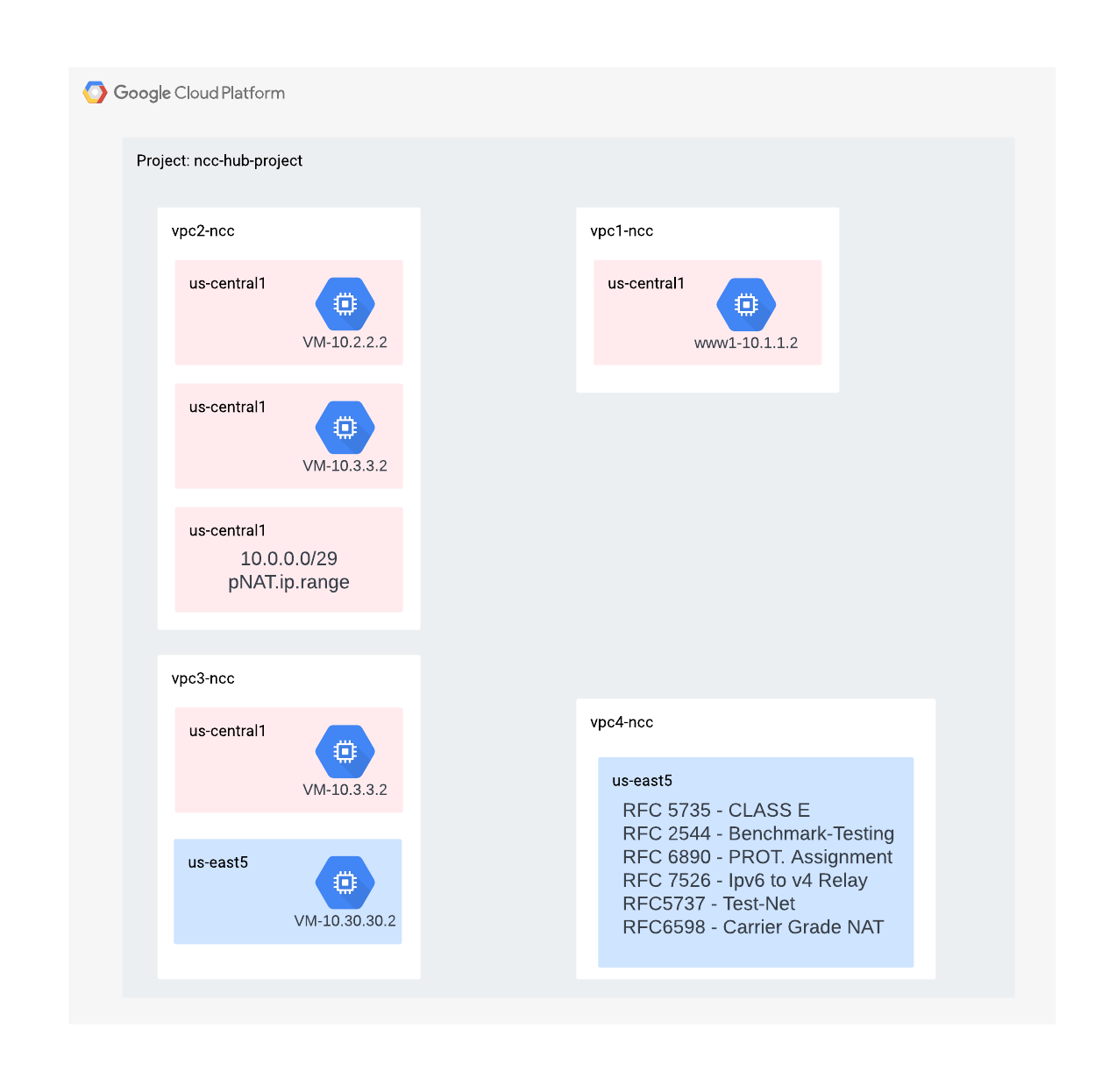

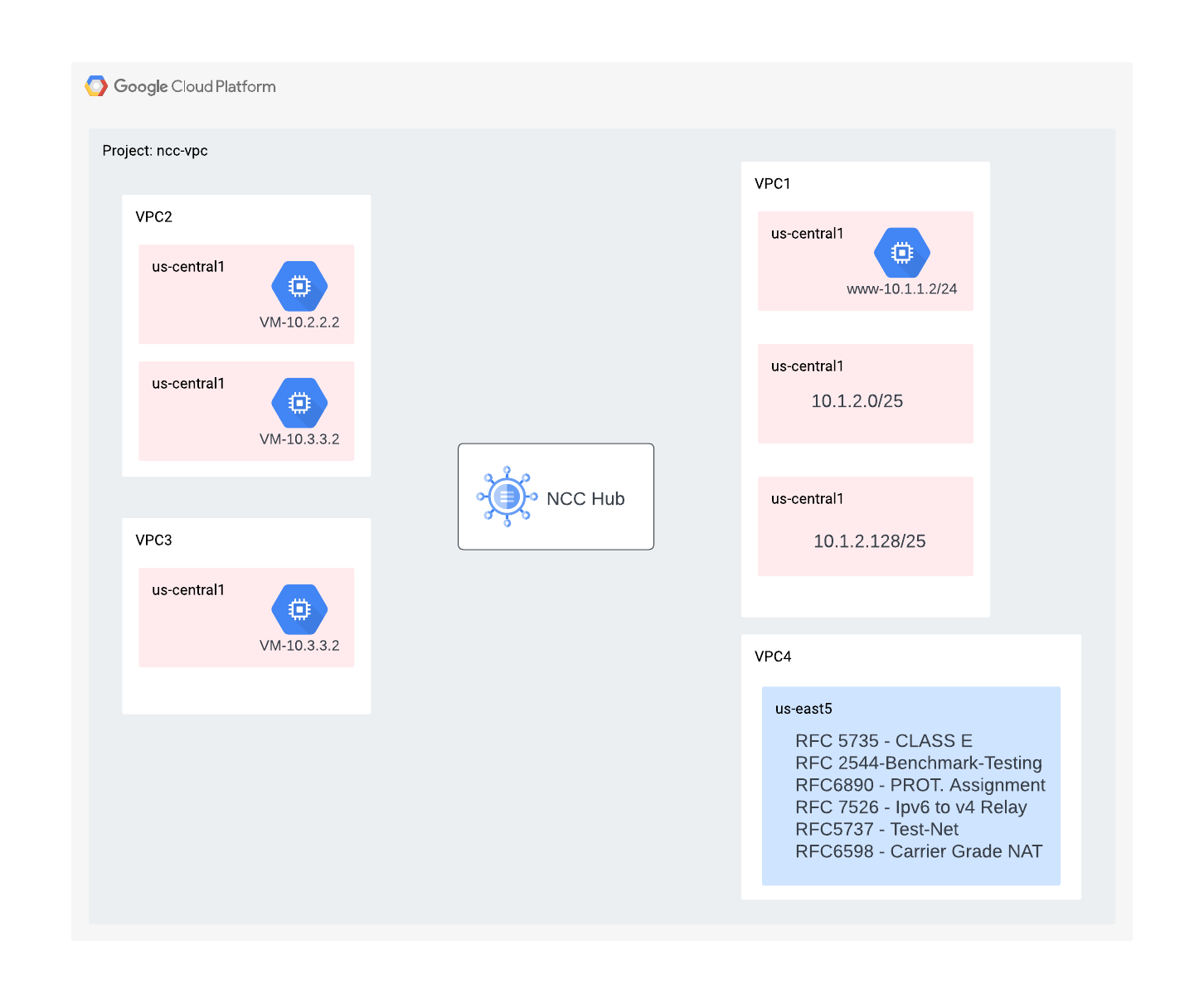

Dans cette section, nous allons déployer les réseaux VPC et les règles de pare-feu dans un seul projet. Le schéma logique illustre l'environnement réseau qui sera configuré à cette étape.

Pour démontrer la compatibilité des spokes multiprojets, nous allons déployer un VPC et des règles de pare-feu dans un autre projet lors d'une prochaine étape.

Créer les VPC et les sous-réseaux

Le réseau VPC contient des sous-réseaux que vous allez installer sur la VM GCE pour la validation du chemin de données

gcloud compute networks create vpc1-ncc --subnet-mode custom

gcloud compute networks create vpc2-ncc --subnet-mode custom

gcloud compute networks create vpc3-ncc --subnet-mode custom

gcloud compute networks create vpc4-ncc --subnet-mode custom

gcloud compute networks subnets create vpc1-ncc-subnet1 \

--network vpc1-ncc --range 10.1.1.0/24 --region us-central1

gcloud compute networks subnets create vpc1-ncc-subnet2 \

--network vpc1-ncc --range 10.1.2.0/25 --region us-central1

gcloud compute networks subnets create vpc1-ncc-subnet3 \

--network vpc1-ncc --range 10.1.2.128/25 --region us-central1

gcloud compute networks subnets create vpc2-ncc-subnet1 \

--network vpc2-ncc --range 10.2.2.0/24 --region us-central1

Plages de sous-réseaux VPC compatibles

NCC accepte toutes les plages de sous-réseaux IPv4 valides, à l'exception des adresses IP publiques utilisées en mode privé. Au cours de cette étape, vous allez créer dans VPC4 des plages d'adresses IP valides qui seront importées dans la table de routage du hub.

gcloud compute networks subnets create benchmark-testing-rfc2544 \

--network vpc4-ncc --range 198.18.0.0/15 --region us-east1

gcloud compute networks subnets create class-e-rfc5735 \

--network vpc4-ncc --range 240.0.0.0/4 --region us-east1

gcloud compute networks subnets create ietf-protcol-assignment-rfc6890 \

--network vpc4-ncc --range 192.0.0.0/24 --region us-east1

gcloud compute networks subnets create ipv6-4-relay-rfc7526 \

--network vpc4-ncc --range 192.88.99.0/24 --region us-east1

gcloud compute networks subnets create pupi \

--network vpc4-ncc --range 50.50.50.0/24 --region us-east1

gcloud compute networks subnets create test-net-1-rfc5737 \

--network vpc4-ncc --range 192.0.2.0/24 --region us-east1

gcloud compute networks subnets create test-net-2-rfc5737 \

--network vpc4-ncc --range 198.51.100.0/24 --region us-east1

gcloud compute networks subnets create test-net-3-rfc5737 \

--network vpc4-ncc --range 203.0.113.0/24 --region us-east1

Créer des plages de sous-réseaux qui se chevauchent

NCC n'importera pas les plages d'adresses IP qui se chevauchent dans la table de routage du hub. Les utilisateurs pourront contourner cette restriction ultérieurement. Pour l'instant, créez deux plages d'adresses IP qui se chevauchent pour VPC2 et VPC3.

gcloud compute networks subnets create overlapping-vpc2 \

--network vpc3-ncc --range 10.3.3.0/24 --region us-central1

gcloud compute networks subnets create overlapping-vpc3 \

--network vpc2-ncc --range 10.3.3.0/24 --region us-central1

Configurer des règles de pare-feu VPC

Configurez des règles de pare-feu sur chaque VPC pour autoriser

- SSH

- IAP interne

- Plage 10.0.0.0/8

gcloud compute firewall-rules create ncc1-vpc-internal \

--network vpc1-ncc \

--allow all \

--source-ranges 10.0.0.0/8

gcloud compute firewall-rules create ncc2-vpc-internal \

--network vpc2-ncc \

--allow all \

--source-ranges 10.0.0.0/8

gcloud compute firewall-rules create ncc3-vpc-internal \

--network vpc3-ncc \

--allow all \

--source-ranges 10.0.0.0/8

gcloud compute firewall-rules create ncc4-vpc-internal \

--network vpc4-ncc \

--allow all \

--source-ranges 10.0.0.0/8

gcloud compute firewall-rules create ncc1-vpc-iap \

--network vpc1-ncc \

--allow all \

--source-ranges 35.235.240.0/20

gcloud compute firewall-rules create ncc2-vpc-iap \

--network vpc2-ncc \

--allow=tcp:22 \

--source-ranges 35.235.240.0/20

gcloud compute firewall-rules create ncc3-vpc-iap \

--network vpc3-ncc \

--allow=tcp:22 \

--source-ranges 35.235.240.0/20

gcloud compute firewall-rules create ncc4-vpc-iap \

--network vpc4-ncc \

--allow=tcp:22 \

--source-ranges 35.235.240.0/20

Configurer une VM GCE dans chaque VPC

Vous aurez besoin d'un accès Internet temporaire pour installer les packages sur "vm1-vpc1-ncc".

Créer quatre machines virtuelles (chaque VM sera attribuée à l'un des VPC créés précédemment)

gcloud compute instances create vm1-vpc1-ncc \

--subnet vpc1-ncc-subnet1 \

--metadata=startup-script='#!/bin/bash

apt-get update

apt-get install apache2 -y

apt-get install tcpdump -y

service apache2 restart

echo "

<h3>Web Server: www-vm1</h3>" | tee /var/www/html/index.html'

gcloud compute instances create vm2-vpc2-ncc \

--zone us-central1-a \

--subnet vpc2-ncc-subnet1 \

--no-address

gcloud compute instances create pnat-vm-vpc2 \

--zone us-central1-a \

--subnet overlapping-vpc3 \

--no-address

gcloud compute instances create vm1-vpc4-ncc \

--zone us-east1-b \

--subnet class-e-rfc5735 \

--no-address

3. Hub Network Connectivity Center

Présentation

Dans cette section, nous allons configurer un hub NCC à l'aide de commandes gcloud. Le hub NCC servira de plan de contrôle chargé de créer la configuration de routage entre chaque spoke VPC.

Activer les services d'API

Activez l'API de connectivité réseau si elle ne l'est pas encore:

gcloud services enable networkconnectivity.googleapis.com

Créer un hub NCC

Créer un hub NCC à l'aide de la commande gcloud

gcloud network-connectivity hubs create ncc-hub

Exemple de résultat :

Create request issued for: [ncc-hub]

Waiting for operation [projects/user-3p-dev/locations/global/operations/operation-1668793629598-5edc24b7ee3ce-dd4c765b-5ca79556] to complete...done.

Created hub [ncc-hub]

Décrivez le hub NCC que vous venez de créer. Notez le nom et le chemin d'accès associé.

gcloud network-connectivity hubs describe ncc-hub

gcloud network-connectivity hubs describe ncc-hub

createTime: '2023-11-02T02:28:34.890423230Z'

name: projects/user-3p-dev/locations/global/hubs/ncc-hub

routeTables:

- projects/user-3p-dev/locations/global/hubs/ncc-hub/routeTables/default

state: ACTIVE

uniqueId: de749c4c-0ef8-4888-8622-1ea2d67450f8

updateTime: '2023-11-02T02:28:48.613853463Z'

Le hub NCC a introduit une table de routage qui définit le plan de contrôle pour créer une connectivité de données. Trouver le nom de la table de routage du hub NCC

gcloud network-connectivity hubs route-tables list --hub=ncc-hub

NAME: default

HUB: ncc-hub

DESCRIPTION:

Recherchez l'URI de la table de routage par défaut NCC.

gcloud network-connectivity hubs route-tables describe default --hub=ncc-hub

createTime: '2023-02-24T17:32:58.786269098Z'

name: projects/user-3p-dev/locations/global/hubs/ncc-hub/routeTables/default

state: ACTIVE

uid: eb1fdc35-2209-46f3-a8d6-ad7245bfae0b

updateTime: '2023-02-24T17:33:01.852456186Z'

Listez le contenu de la table de routage par défaut du hub NCC. Remarque : La table de routage du hub NCC sera vide jusqu'à ce que les spokes soient

gcloud network-connectivity hubs route-tables routes list --hub=ncc-hub --route_table=default

La table de routage du hub NCC doit être vide.

4. NCC avec spokes VPC

Présentation

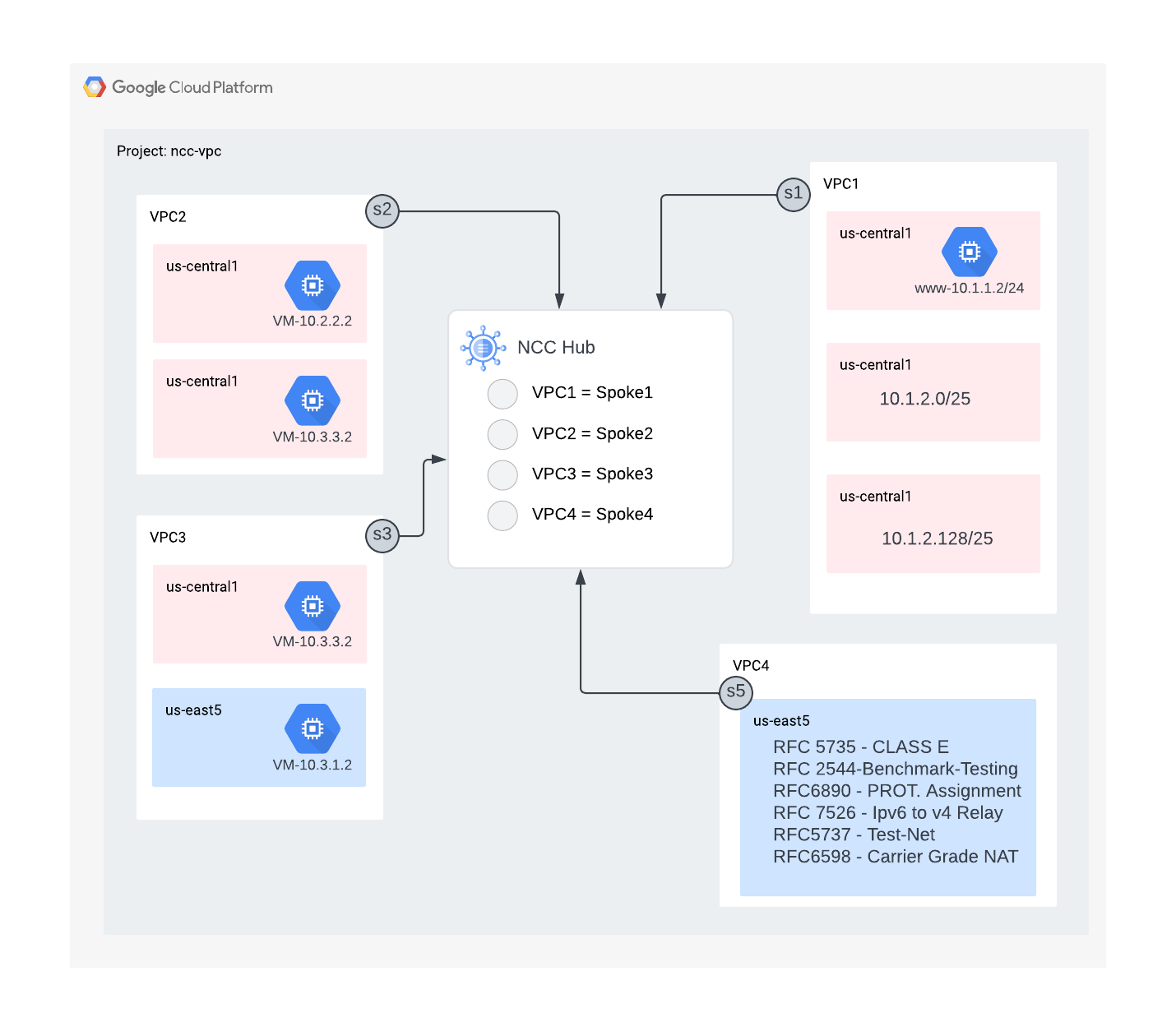

Dans cette section, vous allez configurer trois VPC en tant que spoke NCC à l'aide des commandes gcloud.

Configurer un ou plusieurs VPC en tant que spokes NCC

Configurez le ou les VPC suivants comme spoke NCC dans cet ordre

- VPC4

- VPC1

- VPC2

- VPC3

Configurez le VPC4 en tant que spoke NCC et attribuez-le au hub NCC précédemment créé. Les appels d'API spoke NCC nécessitent la spécification d'un emplacement. L'indicateur "–global" simplifie la syntaxe gcloud en permettant à l'utilisateur d'éviter de spécifier un chemin d'URI complet lors de la configuration d'un nouveau spoke NCC.

gcloud network-connectivity spokes linked-vpc-network create vpc4-spoke4 \

--hub=ncc-hub \

--vpc-network=vpc4-ncc \

--global

Configurez VPC1 en tant que spoke NCC.

Les administrateurs peuvent exclure l'exportation de routes de sous-réseau d'un spoke VPC vers la table de routage du hub NCC. Dans cette partie de l'atelier de programmation, vous allez créer une règle d'exportation d'exclusion basée sur un préfixe de résumé afin d'empêcher le sous-réseau VPC1 d'être exporté vers la table de routage du hub NCC.

Utilisez cette commande gcloud pour répertorier tous les sous-réseaux appartenant au VPC1.

gcloud config set accessibility/screen_reader false

gcloud compute networks subnets list --network=vpc1-ncc

Notez la paire de sous-réseaux /25 créée précédemment dans la section de configuration.

NAME REGION NETWORK RANGE STACK_TYPE

vpc1-ncc-subnet1 us-central1 vpc1-ncc 10.1.1.0/24 IPV4_ONLY

vpc1-ncc-subnet2 us-central1 vpc1-ncc 10.1.2.0/25 IPV4_ONLY

vpc1-ncc-subnet3 us-central1 vpc1-ncc 10.1.2.128/25 IPV4_ONLY

Configurez le VPC1 en tant que spoke NCC et excluez la paire de sous-réseaux /25 de l'importation dans la table de routage du hub à l'aide de la commande "export-excluded-ranges" pour filtrer l'itinéraire de résumé /24 à partir de cette plage spécifique.

gcloud network-connectivity spokes linked-vpc-network create vpc1-spoke1 \

--hub=ncc-hub \

--vpc-network=vpc1-ncc \

--exclude-export-ranges=10.1.2.0/24 \

--global

Remarque : Les utilisateurs peuvent filtrer jusqu'à 16 plages d'adresses IP uniques par spoke NCC.

Listez le contenu de la table de routage par défaut du hub NCC. Qu'est-il arrivé à la paire de sous-réseaux /25 sur la table de routage du hub NCC ?

gcloud network-connectivity hubs route-tables routes list --hub=ncc-hub --route_table=default --filter="NEXT_HOP:vpc1-ncc"

IP_CIDR_RANGE STATE TYPE NEXT_HOP HUB ROUTE_TABLE

10.1.1.0/24 ACTIVE VPC_PRIMARY_SUBNET vpc1-ncc ncc-hub default

Configurer VPC2 en tant que spoke NCC

gcloud network-connectivity spokes linked-vpc-network create vpc2-spoke2 \

--hub=ncc-hub \

--vpc-network=vpc2-ncc \

--global

Configurez VPC3 en tant que spoke NCC et attribuez-le au hub NCC précédemment créé.

gcloud network-connectivity spokes linked-vpc-network create vpc3-spoke3 \

--hub=ncc-hub \

--vpc-network=vpc3-ncc \

--global

Que s'est-il passé ?

ERROR: (gcloud.network-connectivity.spokes.linked-vpc-network.create) Invalid resource state for "https://www.googleapis.com/compute/v1/projects/xxxxxxxx/global/networks/vpc3-ncc": 10.3.3.0/24 (SUBNETWORK) overlaps with 10.3.3.0/24 (SUBNETWORK) from "projects/user-3p-dev/global/networks/vpc2-ncc" (peer)

Le hub NCC a détecté un chevauchement de la plage d'adresses IP avec le VPC2. Rappelez-vous que VPC2 et VPC3 ont été configurés avec le même sous-réseau IP 10.3.3.0/24.

Filtrer les plages d'adresses IP qui se chevauchent avec l'option "Exclure l'exportation"

Au moment de la rédaction de cet atelier de programmation, il s'agit d'un problème connu : les utilisateurs doivent supprimer et recréer des spokes NCC pour modifier la configuration du filtre d'exportation.

gcloud network-connectivity spokes delete vpc2-spoke2 --global --quiet

Remarque:La suppression d'un spoke VPC associé à un VPC spécifique nécessite un délai d'attente de 10 minutes pour expirer afin de recréer un spoke faisant référence à ce même VPC.

gcloud network-connectivity spokes linked-vpc-network create vpc2-spoke2 \

--hub=ncc-hub \

--vpc-network=vpc2-ncc \

--exclude-export-ranges=10.3.3.0/24 \

--global

Configurez VPC3 en tant que spoke NCC et attribuez-le au hub NCC précédemment créé. Cette tentative d'ajout du VPC3 en tant que spoke à NCC devrait aboutir.

gcloud network-connectivity spokes linked-vpc-network create vpc3-spoke3 \

--hub=ncc-hub \

--vpc-network=vpc3-ncc \

--exclude-export-ranges=10.3.3.0/24 \

--global

Listez le contenu de la table de routage par défaut du hub NCC et examinez le résultat.

gcloud network-connectivity hubs route-tables routes list --hub=ncc-hub --route_table=default

Les plages d'adresses IP de VPC2 et VPC3 qui se chevauchent sont exclues. La table de routage du hub NCC est compatible avec tous les types de plages valides IPv4 valides, à l'exception des adresses IP publiques utilisées en mode privé (PUPI).

5. NCC avec des spokes sur plusieurs projets

Présentation

Jusqu'à présent, vous avez configuré des spokes NCC appartenant au même projet que le hub. Dans cette section, vous allez configurer le VPC en tant que spoke NCC provenant d'un projet distinct autre que le hub NCC à l'aide des commandes gcloud.

Cela permet aux propriétaires de projet qui gèrent leurs propres VPC de participer à la connectivité réseau avec le hub NCC.

Multiprojets: console Google Cloud et Cloud Shell

Pour interagir avec GCP, nous allons utiliser à la fois la console Google Cloud et Cloud Shell tout au long de cet atelier.

Console Google Cloud Cross-Project Spoke

La console Cloud est accessible à l'adresse https://console.cloud.google.com.

Configurez les éléments suivants dans Google Cloud pour faciliter la configuration de Network Connectivity Center:

Dans Google Cloud Console, sur la page de sélection du projet, sélectionnez ou créez un projet Google Cloud.

Lancez le Cloud Shell. Cet atelier de programmation utilise $variables pour faciliter l'implémentation de la configuration gcloud dans Cloud Shell.

gcloud auth list

gcloud config list project

gcloud config set project [YOUR-CROSSPROJECT-NAME]

xprojname=[YOUR-CROSSPROJECT-NAME]

echo $xprojname

gcloud config set compute/zone us-central1-a

gcloud config set compute/region us-central1

Rôles IAM

NCC nécessite des rôles IAM pour accéder à des API spécifiques. Veillez à configurer votre utilisateur avec les rôles IAM NCC si nécessaire.

L'administrateur du spoke multiprojet doit disposer au minimum du rôle IAM "networkconnectivity.networkSpokeManager. "

Le tableau ci-dessous liste le rôle IAM requis pour l'administrateur NCC Hub et Spoke à titre de référence.

Rôle/Description | Autorisations |

networkconnectivity.networkAdmin permet aux administrateurs réseau de gérer le hub et les spokes. | networkconnectivity.hubs.networkconnectivity.spokes. |

networkconnectivity.networkSpokeManager : permet d'ajouter et de gérer des spokes dans un hub. À utiliser dans un VPC partagé où le projet hôte possède le hub, mais les autres administrateurs d'autres projets peuvent ajouter des spokes pour leurs rattachements au hub. | networkconnectivity.spokes.** |

networkconnectivity.networkUsernetworkconnectivity.networkViewer permet aux utilisateurs du réseau d'afficher différents attributs de hub et de spoke. | networkconnectivity.hubs.getnetworkconnectivity.hubs.listnetworkconnectivity.spokes.getnetworkconnectivity.spokes.listnetworkconnectivity.spokes.aggregatedList |

Créer les VPC et les sous-réseaux dans le projet Cross-Project

Le réseau VPC contient des sous-réseaux que vous allez installer sur la VM GCE pour la validation du chemin de données

gcloud compute networks create xproject-vpc \

--subnet-mode custom

gcloud compute networks subnets create xprj-net-1 \

--network xproject-vpc \

--range 10.100.1.0/24 \

--region us-central1

URI du projet du hub NCC

Utilisez cette commande gcloud pour rechercher l'URI du hub NCC. Vous aurez besoin du chemin d'URI pour configurer le spoke NCC multiprojet à l'étape suivante.

gcloud network-connectivity hubs describe ncc-hub

VPC Spoke multiprojet

Connectez-vous à l'autre projet dans lequel le VPC ne fait PAS partie du projet du hub NCC. Dans cloudshell, utilisez cette commande pour configurer un VPC en tant que spoke NCC.

- HUB_URI doit être l'URI d'un hub dans un autre projet.

- VPC_URI doit se trouver dans le même projet que le spoke

- VPC-network spécifie que le VPC de ce projet multiprojet rejoindra le hub NCC dans un autre projet

gcloud network-connectivity spokes linked-vpc-network create xproj-spoke \

--hub=projects/[YOUR-PROJECT-NAME]/locations/global/hubs/ncc-hub \

--global \

--vpc-network=xproject-vpc

.

Create request issued for: [xproj-spoke]

Waiting for operation [projects/xproject/locations/global/operations/operation-1689790411247-600dafd351158-2b862329-19b747f1] to complete...done.

Created spoke [xproj-spoke].

createTime: '2023-07-19T18:13:31.388500663Z'

hub: projects/[YOUR-PROJECT-NAME]/locations/global/hubs/ncc-hub

linkedVpcNetwork:

uri: https://www.googleapis.com/compute/v1/projects/xproject/global/networks/xproject-vpc

name: projects/xproject/locations/global/spokes/xproj-spoke

reasons:

- code: PENDING_REVIEW

message: Spoke is Pending Review

spokeType: VPC_NETWORK

state: INACTIVE

uniqueId: 46b4d091-89e2-4760-a15d-c244dcb7ad69

updateTime: '2023-07-19T18:13:38.652800902Z'

Quel est l'état du spoke NCC multiprojet ? Pourquoi ?

6. Refuser ou accepter un spoke multiprojet

Présentation

Les administrateurs du hub NCC doivent accepter explicitement un spoke multiprojet pour rejoindre le hub. Cela empêche les propriétaires de projet d'associer des spokes NCC non autorisés à la table de routage globale NCC. Une fois qu'un spoke a été accepté ou refusé, il peut être refusé ou accepté autant de fois que vous le souhaitez en exécutant les commandes ci-dessus.

Revenez au projet dans lequel se trouve le hub NCC en vous connectant à Cloud Shell.

Identifier les spokes multiprojets à examiner

gcloud network-connectivity hubs list-spokes ncc-hub \

--filter="reason:PENDING_REVIEW"

Accepter un spoke

gcloud network-connectivity spokes accept xproj-spoke --global

Facultatif: Refuser un spoke

gcloud network-connectivity spokes reject xproj-spoke \

--global \

--details="some reason to reject"

Lister les spokes actifs sur Hub

gcloud network-connectivity hubs list-spokes ncc-hub \

--filter="state:ACTIVE"

NAME PROJECT LOCATION TYPE STATE STATE REASON

Xproj-spoke xproj global VPC_NETWORK ACTIVE

vpc4-spoke4 user-3p-dev global VPC_NETWORK ACTIVE

vpc1-spoke1 user-3p-dev global VPC_NETWORK ACTIVE

vpc2-spoke2 user-3p-dev global VPC_NETWORK ACTIVE

vpc3-spoke3 user-3p-dev global VPC_NETWORK ACTIVE

Répertorier les routes de sous-réseau sur le hub

Dans le résultat, pouvez-vous voir les routes de sous-réseau du spoke multi-VPC ?

gcloud network-connectivity hubs route-tables routes list \

--route_table=default \

--hub=ncc-hub \

--filter="NEXT_HOP:xprj-vpc"

IP_CIDR_RANGE STATE TYPE NEXT_HOP HUB ROUTE_TABLE

10.100.0.0/16 ACTIVE VPC_PRIMARY_SUBNET xprj-vpc ncc-hub default

7. NAT privé entre les VPC

Présentation

Dans cette section, vous allez configurer la fonctionnalité NAT privée pour les plages de sous-réseaux qui se chevauchent entre deux VPC. Notez que le NAT privé entre les VPC nécessite NCC.

Dans la section précédente, les VPC2 et VPC3 sont configurés avec une plage de sous-réseau "10.3.3.0/24" qui se chevauche. Les deux VPC sont configurés en tant que spoke NCC pour empêcher l'insertion du sous-réseau chevauchant dans la table de routage du hub NCC, ce qui signifie qu'il n'existe pas de chemin de données de couche 3 pour atteindre les hôtes qui résident sur ce sous-réseau.

Utilisez ces commandes dans le projet du hub NCC pour rechercher la ou les plages de sous-réseaux qui se chevauchent.

gcloud compute networks subnets list --network vpc2-ncc

gcloud compute networks subnets list --network vpc3-ncc

Sur vpc2-ncc, quel est le nom du sous-réseau qui contient la plage d'adresses IP qui se chevauchent ?

*Notez le nom du sous-réseau et gardez-le quelque part. Vous allez configurer la NAT source pour cette plage.

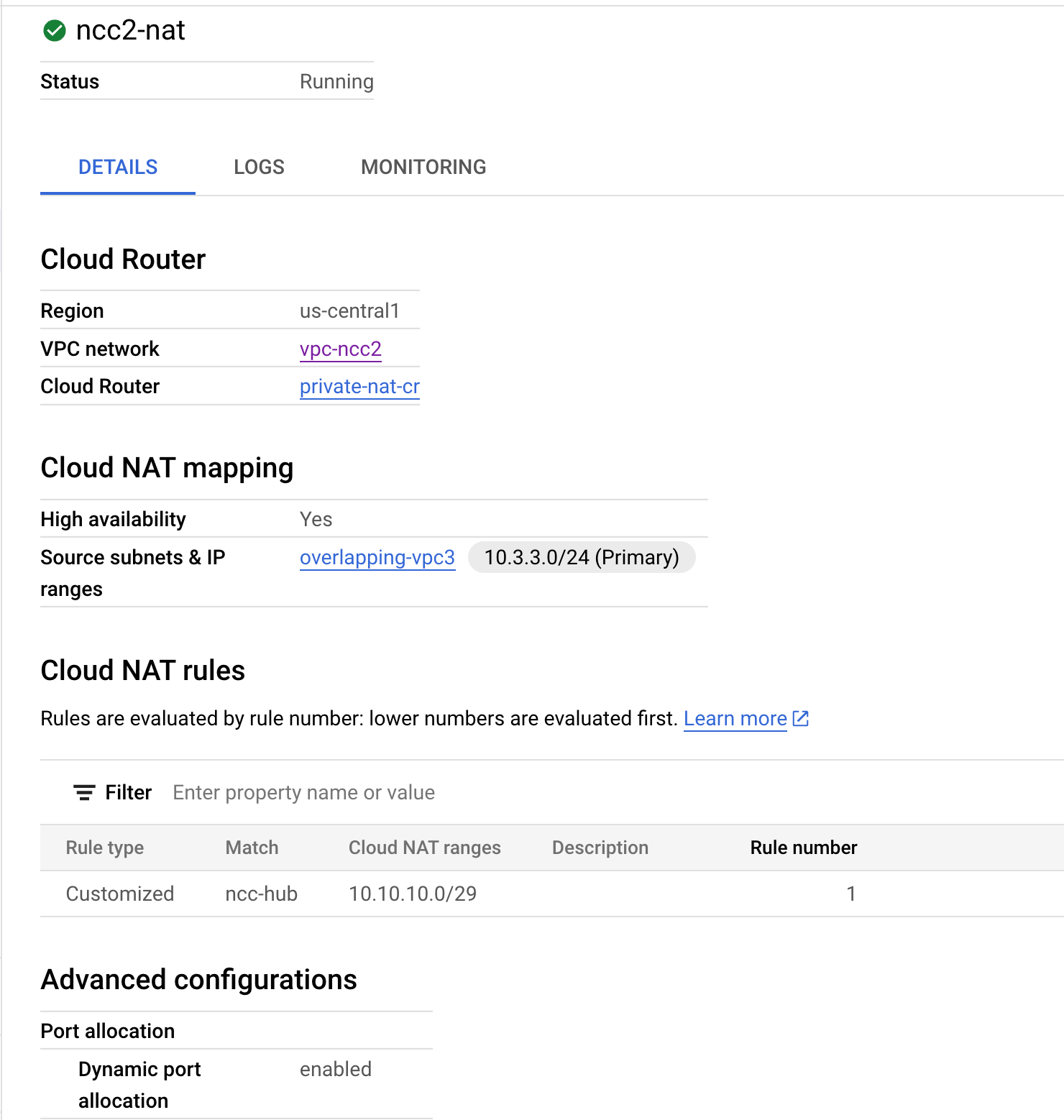

Configurer Private NAT

Dédiez une plage de sous-réseau routable à la source du trafic NAT à partir du sous-réseau VPC2 qui se chevauche. En configurant une plage de sous-réseaux sans chevauchement à l'aide de l'argument "–purpose=PRIVATE_NAT" .

gcloud compute networks subnets create ncc2-spoke-nat \

--network=vpc2-ncc \

--region=us-central1 \

--range=10.10.10.0/29 \

--purpose=PRIVATE_NAT

Créer un routeur cloud dédié pour effectuer une NAT privée

gcloud compute routers create private-nat-cr \

--network vpc2-ncc \

--region us-central1

Configurez le routeur Cloud pour qu'il génère la NAT de la plage de chevauchement 10.3.3.0/24 depuis vpc2-ncc. Dans l'exemple de configuration ci-dessous, "overlapping-vpc3" correspond au nom du sous-réseau qui se chevauche. TOUT LE MONDE spécifie que toutes les plages d'adresses IP du sous-réseau seront soumises au NAT source.

gcloud compute routers nats create ncc2-nat \

--router=private-nat-cr \

--type=PRIVATE \

--nat-custom-subnet-ip-ranges=overlapping-vpc3:ALL \

--router-region=us-central1

Les étapes précédentes ont créé un pool de plages d'adresses IP NAT et le sous-réseau spécifique qui sera traduit. Au cours de cette étape, vous allez créer la règle NAT "1" qui traduit les paquets réseau correspondant au trafic provenant de la plage de sous-réseau qui se chevauche si le réseau de destination prend un chemin de la table de routage du hub NCC.

gcloud compute routers nats rules create 1 \

--router=private-nat-cr \

--region=us-central1 \

--match='nexthop.hub == "//networkconnectivity.googleapis.com/projects/$projectname/locations/global/hubs/ncc-hub"' \

--source-nat-active-ranges=ncc2-spoke-nat \

--nat=ncc2-nat

Vérifier le Private NAT

gcloud compute routers nats describe ncc2-nat --router=private-nat-cr

Exemple de résultat :

enableDynamicPortAllocation: true

enableEndpointIndependentMapping: false

endpointTypes:

- ENDPOINT_TYPE_VM

name: ncc2-nat

rules:

- action:

sourceNatActiveRanges:

- https://www.googleapis.com/compute/projects/yueri-3p-dev/regions/us-central1/subnetworks/ncc2-spoke-nat

match: nexthop.hub == "//networkconnectivity.googleapis.com/projects/yueri-3p-dev/locations/global/hubs/ncc-hub"

ruleNumber: 1

sourceSubnetworkIpRangesToNat: LIST_OF_SUBNETWORKS

subnetworks:

- name: https://www.googleapis.com/compute/projects/yueri-3p-dev/regions/us-central1/subnetworks/overlapping-vpc3

sourceIpRangesToNat:

- ALL_IP_RANGES

type: PRIVATE

Éventuellement,

- Passer à la console Web

- accédez à "Services réseau > Cloud NAT > ncc2-nat

Vérifiez que l'allocation de ports dynamique est activée par défaut.

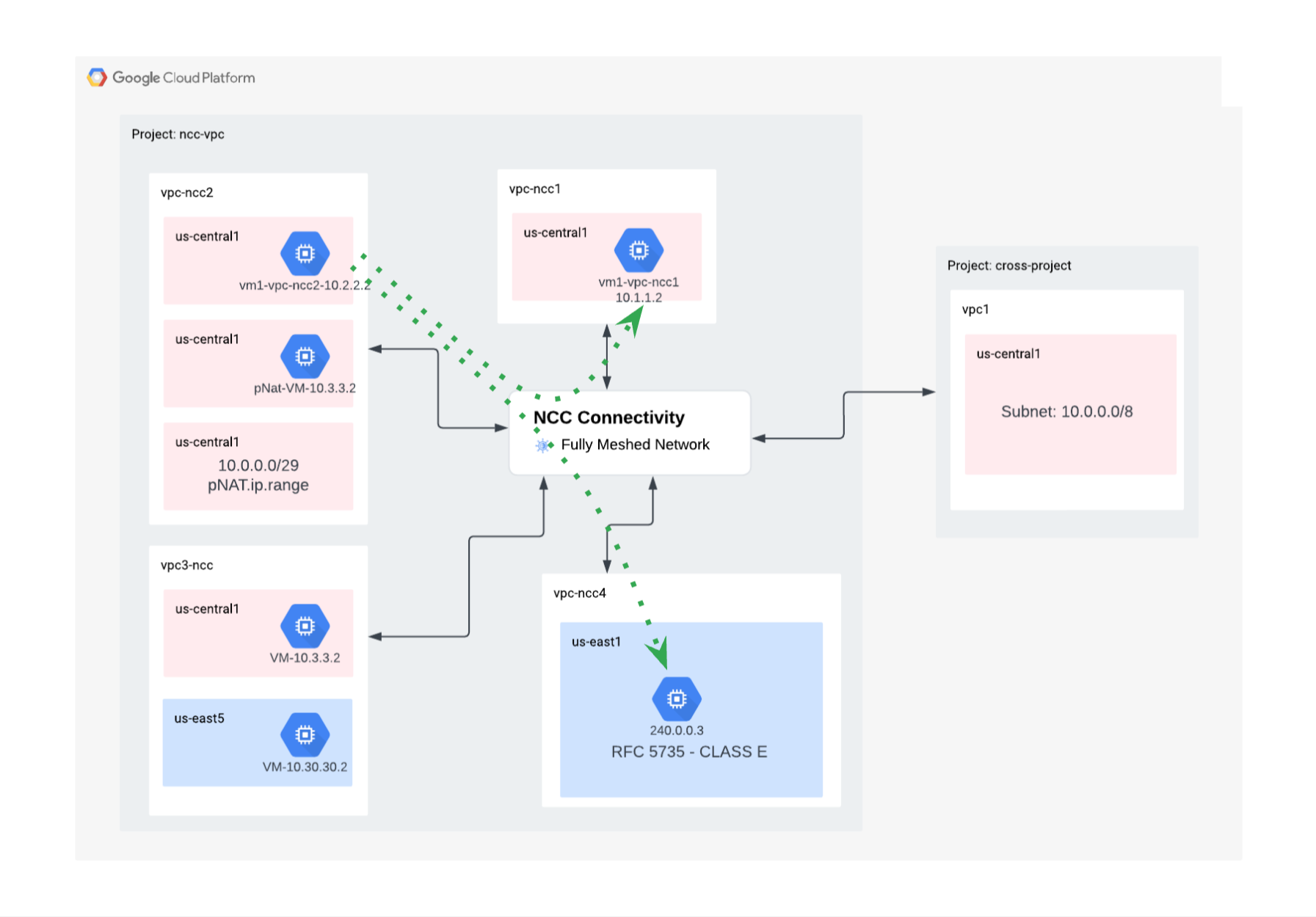

Vous allez maintenant vérifier le chemin de données qui utilise le chemin NAT privé configuré pour VPC2.

Ouvrez une session SSH sur vm1-vpc1-ncc et exécutez la commande tcpdump ci-dessous pour capturer les paquets provenant de la plage de pool NAT "10.10.10.0/29."

vm1-vpc1-ncc

sudo tcpdump -i any net 10.10.10.0/29 -n

Au moment de la rédaction de cet atelier de programmation, la NAT privée n'est pas compatible avec les paquets ICMP. Connectez-vous à "pNat-vm-vpc2" et utilisez la commande curl comme indiqué ci-dessous pour vous connecter à "vm1-vpc1-ncc" sur le port TCP 80.

pnat-vm-vpc2

curl 10.1.1.2 -v

Examinez le résultat de tcpdump sur "vm1-vpc1-ncc". Quelle est l'adresse IP source à l'origine de la session TCP sur notre serveur Web sur "vm1-vpc1-ncc".

tcpdump: data link type LINUX_SLL2

tcpdump: verbose output suppressed, use -v[v]... for full protocol decode

listening on any, link-type LINUX_SLL2 (Linux cooked v2), snapshot length 262144 bytes

19:05:27.504761 ens4 In IP 10.10.10.2.1024 > 10.1.1.2:80: Flags [S], seq 2386228656, win 65320, options [mss 1420,sackOK,TS val 3955849029 ecr 0,nop,wscale 7], length 0

19:05:27.504805 ens4 Out IP 10.1.1.2:80 > 10.10.10.2.1024: Flags [S.], seq 48316785, ack 2386228657, win 64768, options [mss 1420,sackOK,TS val 1815983704 ecr 3955849029,nop,wscale 7], length 0

<output snipped>

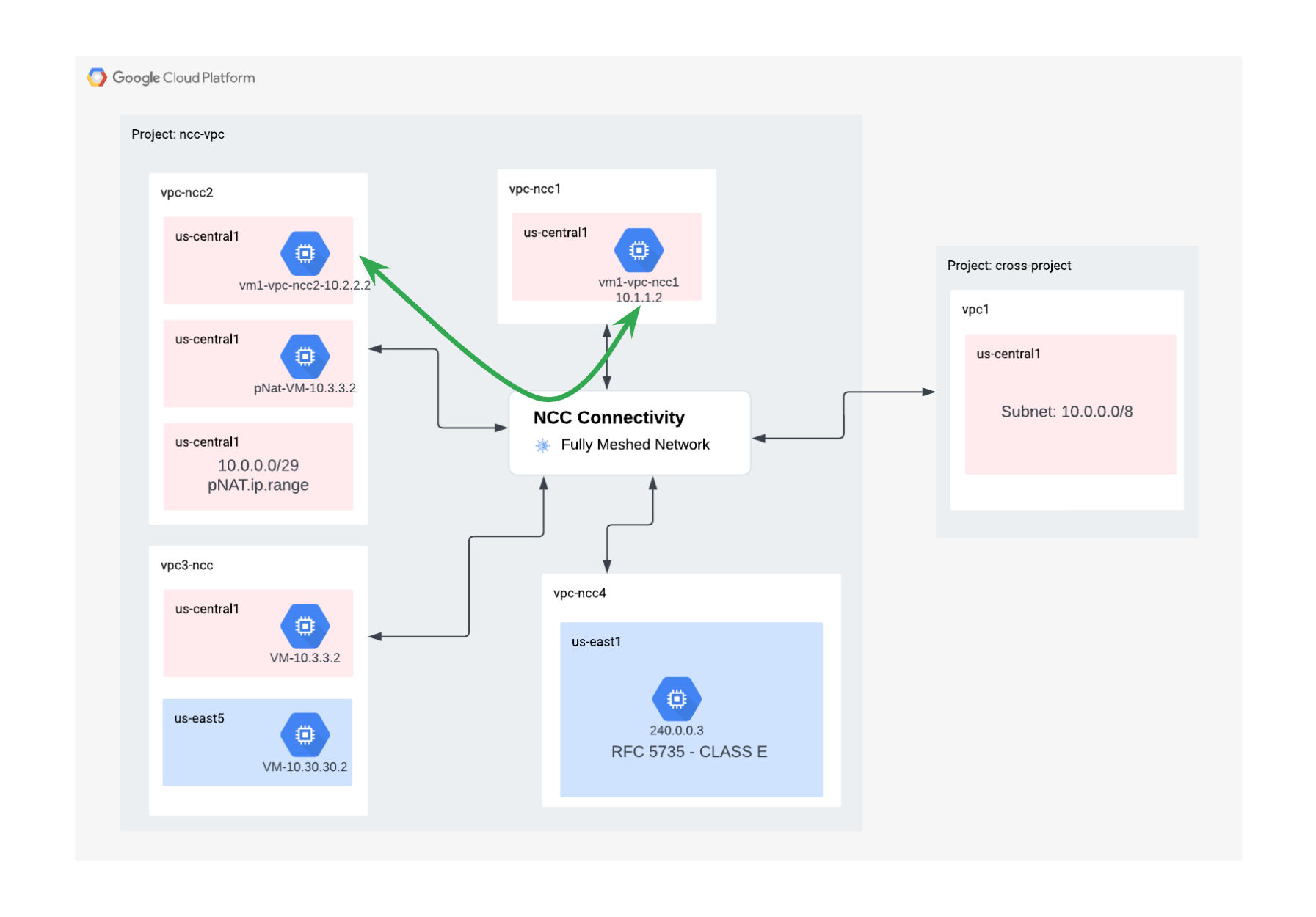

8. Vérifier la connectivité du chemin de données

Consultez le schéma et vérifiez le chemin de données entre chaque machine virtuelle.

Connectez-vous en SSH à vm1-vpc1-ncc et lancez le vidage TCP pour tracer les paquets ICMP de . vm2-vpc2-ncc." Pour rappel, cette VM se trouve sur VPC2.

vm1-vpc1-ncc

sudo tcpdump -i any icmp -v -e -n

Établissez une session SSH avec vm1-vpc2-ncc et "ping" l'adresse IP de "vm1-vpc1-ncc".

vm1-vpc2-ncc

ping 10.1.1.2

Établissez une connexion SSH à "vm1-vpc2-ncc" et "ping" l'adresse IP de "vm1-vpc4-ncc".

vm1-vpc2-ncc

ping 240.0.0.2

9. Effectuer un nettoyage

Se connecter à Cloud Shell et supprimer des instances de VM sur les réseaux des sites hub et des succursales

Supprimer les configurations NAT du VPC privé

gcloud compute routers nats rules delete 1 \

--nat=ncc2-nat \

--router=private-nat-cr \

--region=us-central1 \

--quiet

gcloud compute routers nats delete ncc2-nat \

--router=private-nat-cr \

--router-region=us-central1 \

--quiet

gcloud compute routers delete private-nat-cr \

--region=us-central1 \

--quiet

Supprimer les spokes NCC

gcloud network-connectivity spokes delete vpc1-spoke1 --global --quiet

gcloud network-connectivity spokes delete vpc2-spoke2 --global --quiet

gcloud network-connectivity spokes delete vpc3-spoke3 --global --quiet

gcloud network-connectivity spokes delete vpc4-spoke4 --global --quiet

Refuser le spoke multiprojet

Refusez le spoke VPC multiprojet à partir du hub NCC.

gcloud network-connectivity spokes reject projects/$xprojname/locations/global/spokes/xproj-spoke \--details="cleanup" \

--global

Supprimer le hub NCC

gcloud network-connectivity hubs delete ncc-hub --quiet

Supprimer des règles de pare-feu

gcloud compute firewall-rules delete ncc1-vpc-internal --quiet

gcloud compute firewall-rules delete ncc2-vpc-internal --quiet

gcloud compute firewall-rules delete ncc3-vpc-internal --quiet

gcloud compute firewall-rules delete ncc4-vpc-internal --quiet

gcloud compute firewall-rules delete ncc1-vpc-iap --quiet

gcloud compute firewall-rules delete ncc2-vpc-iap --quiet

gcloud compute firewall-rules delete ncc3-vpc-iap --quiet

gcloud compute firewall-rules delete ncc4-vpc-iap --quiet

Supprimer des instances GCE

gcloud compute instances delete vm1-vpc1-ncc --zone=us-central1-a --quiet

gcloud compute instances delete vm2-vpc2-ncc --zone=us-central1-a --quiet

gcloud compute instances delete pnat-vm-vpc2 --zone=us-central1-a --quiet

gcloud compute instances delete vm1-vpc4-ncc --zone=us-east1-b --quiet

Supprimer des sous-réseaux VPC

gcloud compute networks subnets delete ncc2-spoke-nat --region us-central1 --quiet

gcloud compute networks subnets delete vpc1-ncc-subnet1 --region us-central1 --quiet

gcloud compute networks subnets delete vpc1-ncc-subnet2 --region us-central1 --quiet

gcloud compute networks subnets delete vpc1-ncc-subnet3 --region us-central1 --quiet

gcloud compute networks subnets delete vpc2-ncc-subnet1 --region us-central1 --quiet

gcloud compute networks subnets delete overlapping-vpc2 --region us-central1 --quiet

gcloud compute networks subnets delete overlapping-vpc3 --region us-central1 --quiet

gcloud compute networks subnets delete benchmark-testing-rfc2544 --region us-east1 --quiet

gcloud compute networks subnets delete class-e-rfc5735 --region us-east1 --quiet

gcloud compute networks subnets delete ietf-protcol-assignment-rfc6890 --region us-east1 --quiet

gcloud compute networks subnets delete ipv6-4-relay-rfc7526 --region us-east1 --quiet

gcloud compute networks subnets delete pupi --region us-east1 --quiet

gcloud compute networks subnets delete test-net-1-rfc5737 --region us-east1 --quiet

gcloud compute networks subnets delete test-net-2-rfc5737 --region us-east1 --quiet

gcloud compute networks subnets delete test-net-3-rfc5737 --region us-east1 --quiet

Supprimer un ou plusieurs VPC

gcloud compute networks delete vpc1-ncc vpc2-ncc vpc3-ncc vpc4-ncc

--quiet

10. Félicitations !

Vous avez terminé l'atelier Network Connectivity Center.

Sujets abordés

- Réseau d'appairage de VPC à maillage complet configuré avec le hub NCC

- Filtre d'exclusion des spokes NCC

- Assistance Spoke multi-projets

- NAT privé entre VPC

Étapes suivantes

©Google, LLC ou ses sociétés affiliées. Tous droits réservés. Ne pas diffuser.